基础模型:

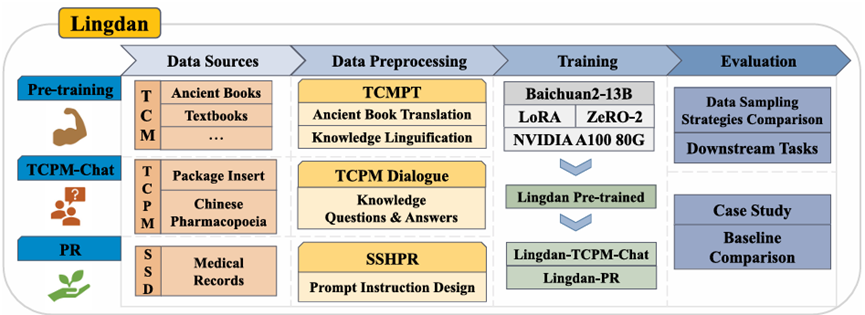

该团队首先整理了大量的中医数据,以训练一个基础的大语言模型(LLM),即灵丹预训练模型。基于该基础模型,我们利用药品说明书和《中国药典》中的数据,开发了一个用于传统中成药(TCPM)对话的LLM,命名为灵丹-TCPM-Chat。此外,我们还利用脾胃疾病(SSD)的门诊数据,训练了一个用于脾胃草药处方推荐的LLM,即灵丹-PR。这些模型的每一个都经过了详细的数据处理和训练方法的记录,并进行了全面的评估。

古籍数据:

精心挑选了1522本中医古籍,涵盖13类内容,包括医学经典、药学著作和各种临床专业书籍。这些中医经典著作,如《黄帝内经》和《本草纲目》,是中医知识传承的重要载体。它们包含了与理论知识、诊断方法、治疗原则及药物应用相关的高质量核心资源,适用于中医临床决策和研究。然而,由于文言文的复杂语法结构和理解难度,必须将这些古籍翻译成现代汉语。为了达到更高的翻译质量,我们对 Baichuan2-13B-Chat、ChatGLM3、Llama2-13B-Chat 和 ChatGPT-3.5 的翻译任务表现进行了比较分析,最终选择了 Baichuan2-13B-Chat 作为翻译过程中的首选工具,以确保这些历史文本中丰富且复杂的知识得到有效的解读和分析。

知识语言化:

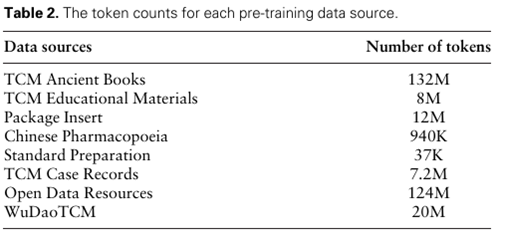

提取了关于中草药和中成药的重要信息,进行了详细的数据清理并进行了结构化存储。随后,这些信息通过 ChatGPT-3.5 处理为自然语言文本

基础模型:

Baichuan2-13B-Base

模型训练:

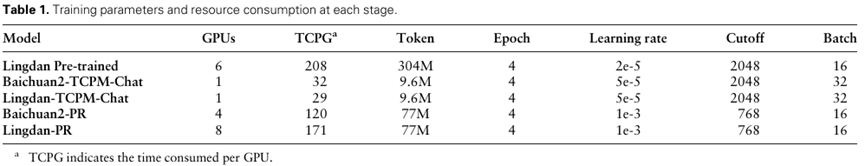

考虑到对拥有130亿参数的模型进行全参数微调所需的大量资源,并结合近期研究中低秩适配器(LoRA)在微调中的显著表现,模型训练在6台NVIDIA A100-80G GPU上执行,使用了基于LoRA的高效微调方法——QLoRA。为提高训练效率,使用了ZeRO-2(零冗余优化器)进行数据和参数的并行训练策略。在LoRA的超参数配置方面,LoRA的秩越高,内存占用和时间消耗就越大。参考之前的类似研究,LoRA的秩为8,alpha为32的配置表现良好。因此,本研究中的LoRA参数设置如下:LoRA秩为8,LoRA alpha为32,LoRA dropout率为0.1。

数据采样策略:

- 中医领域的数据:公共数据=9:1

- 中医领域的数据:公共数据=1:1

Lingdan-TCPM-Chat

知识问答化:

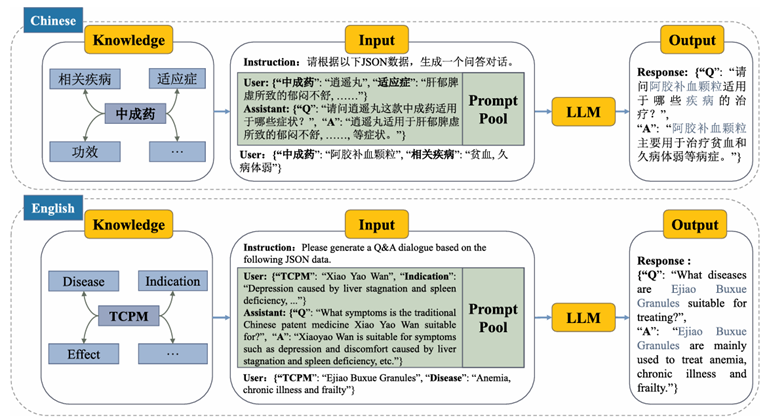

选择了药品说明书和《中国药典》中与TCPM相关的数据,这些数据包括药物特性、相关疾病、物理特征、主要成分和适应症。特别是,药品说明书提供了广泛的药物安全性数据,涵盖了不良反应、禁忌症、注意事项以及针对不同人群(如孕妇、哺乳期妇女、儿童和老年人)和药物相互作用的具体使用指南。为了确保数据的多样性和标准化,从提示池中随机选择提示。这种方法引导ChatGPT-3.5处理提示并以JSON格式返回结果,从而在保证数据多样性的同时标准化输出。

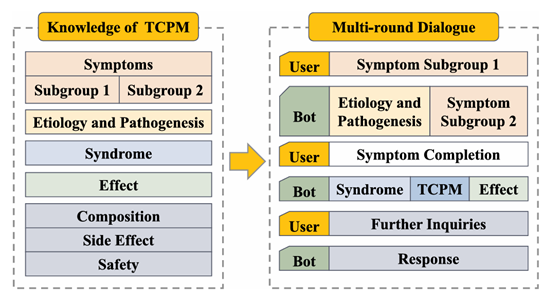

中医互动诊断对话框架:

基于链式思维(Chain-of-Thought, CoT)方法的中医互动诊断对话框架(TCM-IDDF)。

- 用户描述与第一个子组相关的症状。模型的响应包括对这些症状相关的病因和发病机制的分析,随后询问用户是否存在第二个子组的症状。

- 在用户回应关于第二组症状后,模型根据综合症状学确定可能的中医证候推荐合适的中成药,并解释其具体的功效和治疗效果。

- 用户 – 症状子组1 (User – Symptom Subgroup 1):用户首先描述与症状子组1相关的症状。

- 机器人 – 病因和发病机制 & 症状子组2 (Bot – Etiology and Pathogenesis & Symptom Subgroup 2):机器人分析这些症状的病因和发病机制,并询问用户是否存在与症状子组2相关的症状。

- 用户 – 补充症状 (User – Symptom Completion):用户对症状子组2的询问进行回应。

- 机器人 – 证候、TCPM推荐和疗效 (Bot – Syndrome, TCPM, Effect):机器人根据综合的症状确定证候,推荐合适的中成药,并解释它们的疗效。

- 用户 – 进一步询问 (User – Further Inquiries):用户可能对中成药的成分、副作用和安全性有进一步的询问。

- 机器人 – 回应 (Bot – Response):机器人根据用户的进一步询问提供回应。

Lingdan-PR

数据预处理:

这项工作最终创建了脾胃草药处方推荐(SSHPR)数据集,该数据集包含39,122条记录,专门用于指令微调。每条记录由一个预定义的指令组成:“请根据以下患者的情况开具中药方:”,同时包括输入和输出。输入包含患者的主诉和现病史,输出则是医生提供的中医草药处方。